11月26日(金) 、東京・渋谷のLoftworkGroundにて「第2回 だれもが使えるウェブコンクール シンポジウム」が開催された。

「だれもが使えるウェブコンクール」とは、高齢者や障碍者など、より多くの人々や多様な環境からでもアクセスできるWebサイトを選び、表彰する活動である。同シンポジウムは、現在行われている第2回のコンクールに連動し、この活動を啓蒙する集まりとして企画されたもの。

『「 だれもが使える」ウェブから、「 だれもが必要とする」ウェブへ」 』と題された今回のシンポジウムの基調講演は、障碍者向けのアクセシビリティの研究等で知られるIBMフェローの浅川智恵子さんがスピーカーとして登場した。

アクセシビリティは「少数派のための技術」ではない

浅川さんは日本アイ・ビー・エム 東京基礎研究所でアクセシビリティの研究を行っている。今回は「アクセシビリティは世界を変える技術へ」というタイトルで、コンピューティングにおけるアクセシビリティのこれまでの進化や、浅川さん自体も関わるIBMでのアクセシビリティ向上の取り組みについて語った。

浅川智恵子さん。週に何本もの講演をこなすハードスケジュールの中でのお話だった。

まず「ICT(情報通信技術)におけるアクセシビリティは、少数派のための技術と考えられがちだが、そうではない」と切り出した。たとえば電話。発明したグラハム・ベルは、家族に障碍者がいたため、その人とのコミュニケーションをとるために考え出したという。またキーボードも、元々は上肢障碍者の支援用に考案されたものとのこと。そして、文字認識と音声認識はいうまでもなく現在さまざまな分野で活用されている。アクセシビリティを向上させる技術は、多くの人に恩恵を与えているのである。

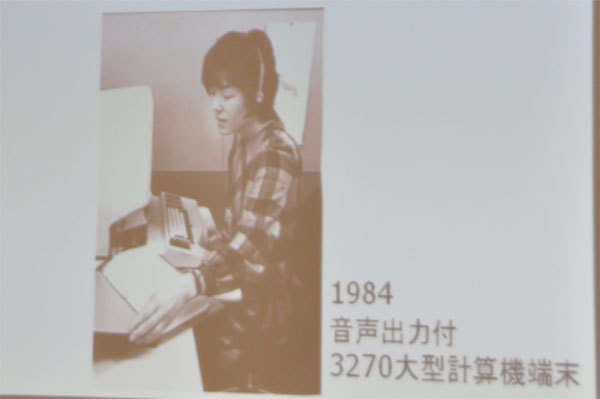

そして、IBMではどのようにアクセシビリティ向上に取り組んでいるのか? 歴史を紐解くと、International Business Mascine(IBM)の名の通り、同社の原点である事務機器の分野で登場したのが1960年代に登場した音声タイプライターだ。そして'84年には最初の音声出力付きのメインフレーム端末が開発され、これが'88年のDOS版の音声読み上げソフトにつながっていく。

IBMの汎用機用音声出力端末。操作しているのは入社当時の浅川さん。この端末は現在は博物館に展示されているそうだ。

浅川さんはこうした開発に関わる中、実際に電子化された情報に触れたとき「これはすごい。情報の海の中に飛び込んでいくのはすばらしい」と思った。そして、この感覚をみんなに体験させてあげたいと考えた。また同時に、情報へのアクセス自体が社会参加に大きな意味を持ち、アクセスできないイコール社会参加できないということを実感した。この思いが現在も続く活動の原点になっているという。

Webアクセシビリティ向上のために

続いて、話題はインターネット(とWeb)に移った。浅川さんも開発に関わり1997年に日本で製品化した「IBMホームページリーダー」は合成音声によるWebテキストの読み上げに加え、リンクやフォームの入力にも対応したソフトウェア。現在では世界11ヵ国後に対応する製品となった。これにより、1990年代後半に視覚障碍者の社会参加の道具として、インターネットに大きな期待が集まった。

ここで音声合成についての実際のデモが行われた。まず最初に1980年代に作られた音声である文章を読み上げると、一応聞き取れるが、非常に滑舌が悪くぼやけたような発音で、浅川さんも「この品質で(目の不自由な)私たちが聞き続けることができるかはかなり疑問」と評した。次に流れた1990年代の音声は、促音や吃音もはっきりと再生され、格段に聞きやすくなった。さらに2004年の技術では、音声に抑揚や強弱を入れることができるようになっている。そして現在の状況として流れた男女2人の会話は、英語ではあるが人間が話しているのとほぼ変わらないの感情が込められ、笑い声や咳払いも自然な形で合成されていた。

浅川さんも「自分で英語をしゃべるより、( この合成システムに)しゃべってもらいたいくらい(笑) 」としつつも、現状ではここまでのクオリティに持っていくためには事前に多くのパラメータ設定が必要とのことで、今後はこうした事前設定なしに自然な発声が可能な技術の開発が期待されている。

次に、こうしたシステムを実際に使って、インターネットで特定のタスクを実行した場合の実験結果が紹介された。通常、視覚障碍者はそうでない人の2倍~2.5倍の速度で流れる音声を聞き取ることができるという。にもかかわらず、読み上げソフトを使い、オンラインショップで「冬ソナ」のDVDをカートに入れるまでの時間を比較したところ、晴眼者が平均1分以内に完了したのに対して、視覚障碍者は平均600秒以上かかり、中にはカートに入れることができなかった人もいたとのこと。こうした「生産性の違い」が大きな問題で、これには各Webサイト自体のアクセシビリティが大きく関係している。

サイトのアクセシビリティ向上はW3C勧告のWCAG(Web Content Accessibility Guidelines)をはじめ、各国にさもまざまな取り組みがあり、米国などでは法律化されているが、日本では法律にはなっていない。こうした国別の対応による差の他、ビジュアルがますます重視されるWebの流れの中で、ガイドラインはあっても画面を見ただけではアクセシビリティの善し悪しがわからないという面も大きいと浅川さんは言う。

こうしたアクセシビリティを判断するために浅川さんの部署が開発したのがaDesigner(エーデザイナー)というソフトウェアだ。視覚障害者や高齢者にもアクセスしやすく使いやすいページを作れるように、Webページ制作者を支援するツールである。高齢者、弱視者からそのページがどのように見えるかをシミュレートしたり、アクセシビリティ/ユーザビリティの自動チェックを行うことができる。ここで実際にaDesignerのデモが行われた。

aDesignerデモの模様。左が通常の見え方で右が低視力者用シミュレーション。赤い色が緑に近づくことで、どこが見えにくくなるかが確認できる。デモを担当したのは日本IBMの高木氏。

音声読み上げ時の評価画面。グレーがかったテキストは読み上げ時間を表す。暗いテキストほど時間がかかる=アクセシビリティが悪いと評価される。

aDesignerはオープンソースソフトとして公開されており、Eclipse Accessibility Tools Framework(ACTF)プロジェクトのダウンロードページ から入手が可能。

「ソーシャル・アクセシビリティ」のもつ可能性

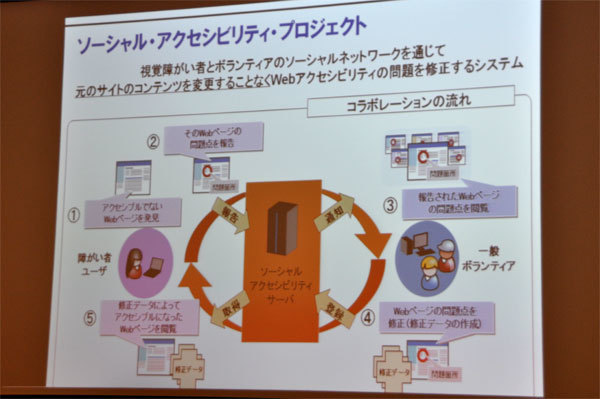

次に、Webアクセシビリティ向上のための新たな取り組みとして、ソーシャルネットワークを利用する活動が紹介された。これは「IBM Social Accessibility Project」

たとえば普通のサイトの場合、アクセシビリティの問題点を指摘して改善を求めるメールを送っても、実際に反映されるまでに時間がかかったり、改善に至らない場合も多い。これに対してSocial Accessibility Projectでは、問題点をソーシャルネットワークに報告し、これに対してボランティアの修正者が即座に対応する。いわゆる「クラウドソーシング」の仕組みを利用したシステムだ。

Social Accessibility Projectの概要

動画による説明も行われた(これは「IBM Social Accessibility Project」のサイト ) 。

浅川さんが学会でこの活動について発表したところ、アカデミックで大きな反響があったという。そして、たとえば、町の中で見かけるアクセシブルな場所とそうでない場所の写真をとってソーシャルネットに報告するといった、浅川さんらの活動をフォローするようなさまざまな研究が行われるようになった。

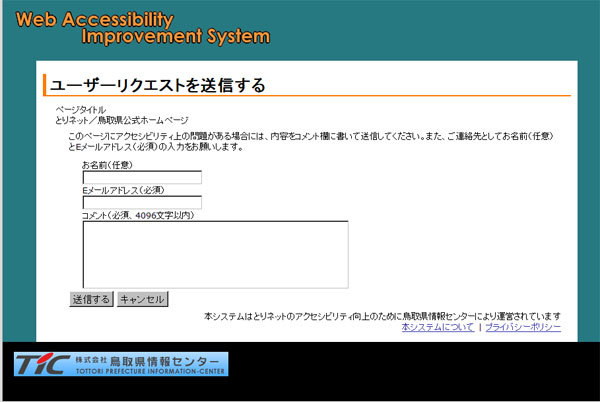

そして、実際にSocial Accessibility Projectに参加しているサイトとして、鳥取県の公式サイト が紹介された。同サイトのすべてのページの右下に「アクセシビリティの問題を報告」するアイコンが置かれ、これをクリックして送信フォームから問題点の報告を送り、問題を修正作業者に直接連絡する。

鳥取県サイトのアクセシビリティリクエスト送信フォーム

修正はプログラマでなくても可能なGUIが用意され、この修正作業を障碍者に依頼している。アクセシビリティの善し悪しが判断できるのは障碍者であり、同時に障碍者の職域拡大も目指しているという。

情報へのアクセスが人権になる

さらに新たな課題として、マルチメディアのアクセシビリティについての取り組みが紹介された。映像、動画に字幕や説明用の副音声が用意されている割合は、現状では極めて少ないと言わざるを得ない。また音声ガイドが適切かどうかにも問題がある。たとえば映画の音声ガイドは、セリフなどがない無音のところに説明音声を入れる必要があり、これが制限になってしまう。

もうひとつの大きな問題は、音声ガイドを制作するコストだ。まず台本を作るには、短時間で情景説明をまとめるスキルが必要で、さらに録音には熟練したナレーターと録音設備が必要になる。これを解決するのが音声合成である、と浅川さんは言う。音声合成で先の録音部分のコストを削減し、さらに専用ツールを作ることで台本作成のコストもある程度圧縮可能となる。さらにこれをHTML5で標準化することで、コストを削減する。現在浅川さんの部署で、音声ガイド制作用のエディタを開発中、またHTML5の標準化についても、W3Cにメンバーを送って提案を行っているところだ。

このほか、電子技術を使ったアクセシビリティの研究成果として、IBMの研究ではないが「バーチャル白杖」と呼ばれるも紹介された。これは実際の杖ではなくレーザーで地面の起伏を捉え、それを振動子を使ったデバイスで手に伝えるというもの。同じ原理を使った「バーチャル点字ブロック」も研究されているという。

最後に、日本に訪れつつある超高齢化社会に言及した。2050年には65歳以上の人口が総人口の41%に達するという予測を紹介し、こうした流れの中で発声しつつある「高齢者の若返り現象」に注目しているという。「 元気高齢者」と呼ばれる人たちだ。「 人生50年」と言われたころから現在は平均寿命が80歳となり、そのうち100歳となるかもしれない。こうした社会では、高齢者も社会貢献しなくてはならなくなる。

浅川さんは、ここで重要な役割を果たすのがITによって高齢化によるハンディキャップを補う技術だと考えている。現在研究しているのが「ささやきインターフェース」だ。これは音声によるAR(拡張現実)技術を活用しており、たとえば自動券売機の前で動きが止まっている人がいたら、それを感知して使い方を音声で「ささやく」というもの。困っているお年寄りを通りがかった人がサポートするような感覚だ。

まとめとして、国連障害者の権利条約を例に「情報へのアクセス自体が人権のひとつとして認められるのが世界の動き」と紹介。「 ダイバーシティ(多様性)への潮流が起こりつつある。企業においても、社会においてもダイバーシティをむしろ活用していかなければならない。Webを社会のインフラとして、世界中の人たちが使い続けられる良いものにしなければならないと思っています。そして私は研究やセミナーを通して活動していくことで、Webが誰もが使えるものになると信じています。」と結んだ。