さくらインターネットは2025年9月24日、生成AI向け推論API基盤

【ニュースリリース】

— 【公式】さくらインターネット (@sakura_pr) September 24, 2025

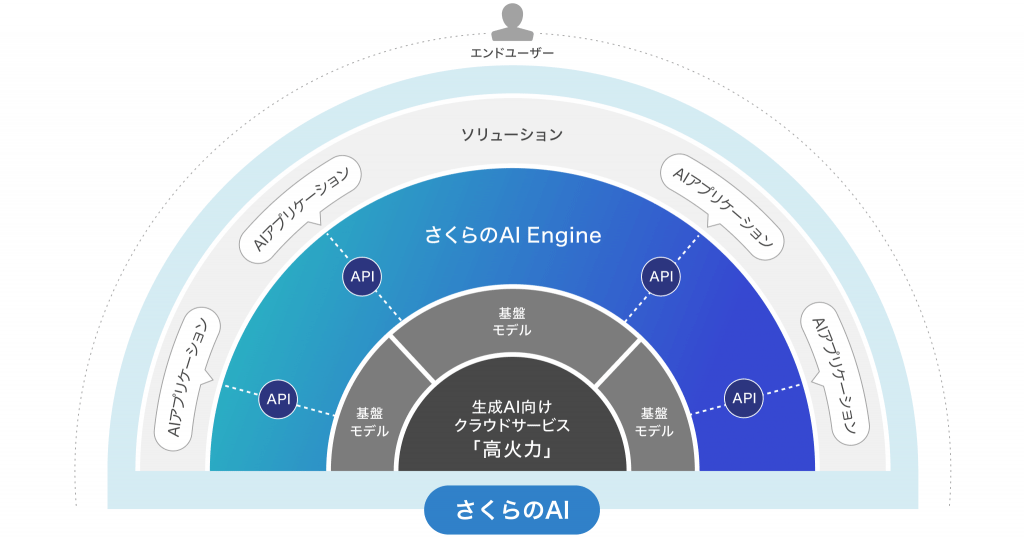

さくらインターネットは、生成AI向け推論API基盤「さくらのAI Engine」 を2025年9月24日 (水) より一般提供を開始します。

詳細は以下をご覧ください。https://t. co/ prbU8dfL3x

「さくらのAI Engine」

これらはすべて同社が運営する国内のデータセンターで構成されたインフラ上で利用可能なため、機密情報や個人情報を国内で取り扱うことができる。またこれにより、公共分野や高いセキュリティ要件が求められる業種でも安心して導入できるとのこと。

「さくらのAI Engine」

- チャットモデル

-

- Qwen3-Coder-30B-A3B-Instruct

- Qwen3-Coder-480B-A35B-Instruct-FP8

- gpt-oss-120b

- llm-jp-3.

1-8x13b-instruct4

- ベクトル埋め込みモデル

-

- multilingual-e5-large

- 音声の文字起こしモデル

-

- whisper-large-v3-turbo

料金プランは

なお、