10月26、27日の2日間、東京・新宿ヒルトンにおいてホートンワークスジャパン主催のカンファレンス「Hadoop Summit 2016 Tokyo」が行われました。Hadoopカンファレンスとしてはグローバルでもっとも規模の大きい「Hadoop Summit(主催: Hortonworks) 」の初の東京開催であり、国内ではめずらしい有料のITイベントということもあって、業界関係者からはその成否が注目されていたカンファレンスでもあります。本稿ではこのイベントの全体像を振り返りながら、IT、そしてビジネスの世界におけるHadoopの位置づけをあらためて考えてみたいと思います。

Hadoop Summit Tokyoとは

gihyo.jpの読者であればご存知の方も多いでしょうが、あらためてHadoop Summitというカンファレンスについて簡単にその概要を紹介しておきます。

Hadoop Summitは、米Hortonworksが米サンノゼをはじめ、欧州、オーストラリアなど世界各地で年に数回開催する、Hadoopコミュニティのためのカンファレンスです。Hadoopのイベントとしては世界最大級で、技術とビジネスの両方の側面からHadoopの最新事情に触れることができます。とくにHortonworksの本拠地である米サンタクララにほど近いサンノゼで毎年6月に開催される「Hadoop Summit San Jose」は年々規模が拡大しており、2016年は世界36ヵ国から4000人を超えるHadoop関係者が集結しています 。

このHadoop Summitが今回はじめて東京で開催されると聞いたとき、筆者は正直かなり驚いたことを覚えています。米国のITカンファレンス、とくに参加者が数千人規模で期間も2日間以上の場合は有料であることがほとんどで、参加費用はひとりあたり10~20万円ほどかかります。もちろんサンノゼのHadoop Summitも同様です。

一方、日本国内ではこのレベルの有料カンファレンスはほぼ皆無で、大手海外ベンダが主催する数千人規模のイベントであっても参加費は無料であることがほとんどです。そうした中、2日間で最低価格3万2000円からの設定での有料カンファレンス、しかもHadoopという参加者をかなり限定するフィルタリングがかけられるITイベントが国内で成功するのかどうか、少なからず疑問に感じたのは確かです。

ですが結果として、開催前週にはチケットがソールドアウト、2日間の参加者は400名を超え、48のブレイクアウトセッションは満席がほとんど、中には立ち見も出る盛況ぶりでした。有料カンファレンスということもあり、事前登録者の歩留まりも非常に高く、イベントとしては成功裏に幕を閉じたといえそうです。

満席となった初日基調講演の会場

なお初日(10/26)キーノートに登壇したHortonworksのマーケティング担当バイスプレジデント ジョン・クレイサ(John Kreisa)氏によれば、2016年に行われた4つのリージョン(米サンノゼ、アイルランド・ダブリン、オーストラリア・メルボルン、東京)におけるHadoop Summitのトータルの参加者は6500名とのこと。2010年が1000名強だったことを考えれば、この数年でHadoopがいかに普及してきたのか、その参加者数の変遷からうかがい知ることができます。

John Kreisa氏

オンプレミスからクラウドへ ―Hadoopのこれまでとこれから

26日、27日ともにキーノートが行われ、初日はHadoopを中心とするデータ分析市場のトレンドとその中におけるHadoopの位置づけについて、そして2日目はHadoopおよびHortonworksの技術的進化の方向性について、それぞれ語られました。マーケティングメッセージとテクニカルメッセージに分けて発信されたという印象です。

データ分析市場の現在について、キーノートに登壇したHortonworks ストラテジ担当バイスプレジデント ショーン・コナリー(Shaun Connolly)氏はデータの巨大化が進行している一例として

2020年までにデータ量は44ゼタバイトまで拡大(2012年は2.8ゼタバイト)

ビッグデータビジネスに投資するエンタープライズ企業は全体の64%

管理されていないデータは全体の88%

1ペタバイト以上のデータを扱うようになると想定している企業は31%

といういくつかの数字を示し、ビジネスにおけるデータの重要性が拡大していること、そして巨大化/多様化するデータをスケーラブルに格納するHadoopの存在感が高まっていることをあらためて強調しています。

Shaun Connolly氏

とくに、ここ1、2年はエンタープライズ企業のクラウドへのデータ移行が急速に進んでいることを受け、"Hadoop-on-Cloud"、クラウド上でのHadoopクラスタ稼働が増えることが予想されていますが、このトレンドについてコナリー氏は、Hortonworksの戦略として、「 ヒストリカルデータのような"Data-at-Rest(動かないデータ)"とストリーミングデータのような"Data-in-Motion(流れるデータ)"をそれぞれ最適な場所に置き、自在に接続/連携させる"Connected"な環境を提供する」ことを挙げています。これはサンノゼのサミットにおいても語られていた内容であり、データセンター(オンプレミス)とクラウドの連携は、今後のHadoopビジネスでもっとも注目されるトレンドであることは間違いないでしょう。

"Data-at-Rest"と"Data-in-Motion"

なおHortonwroksは、Apache Hadoopをベースにした「Hortonwroks Data Platform(HDP) 」とデータフローオーケストレーションを実現するApache NiFiをベースにした「Hortonworks DataFlow(HDF) 」でもって、静的なデータも動的なデータも場所を問わずに、かつシームレスに連携できることを強調しています。

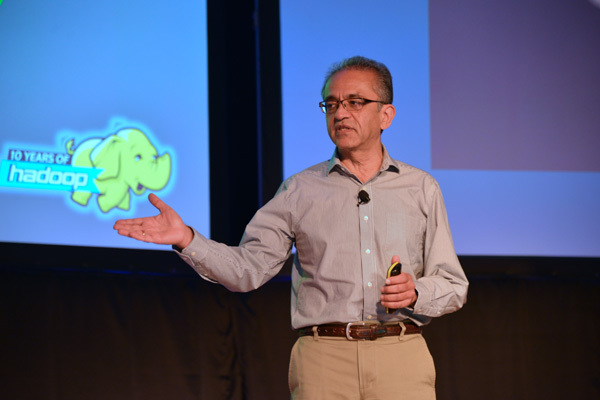

一方、2日目のキーノートにはHortonwroks創業者のひとりであり、同社のチーフアーキテクトを務めるサンジェイ・ラディア(Sanjay Radia)氏が登壇、誕生から10年を迎えたHadoopが到達してきた技術的マイルストーンと、Hadoopの今後の開発方針について紹介がありました。

ラディア氏はまず「2006年に誕生したHadoopにとって、最大のイノベーションは2011年のYARN登場だった」と振り返っています。YARNがリソースマネジメントを引き受けたことにより、SparkなどMapReduce以外の実行エンジンの誕生につながり、「 Hadoop=バッチ処理オンリー」というハードルを超えることができたからです。

また、Hadoopエコシステムのなかでもっとも人気の高いSQLデータウェアハウス環境のHiveについても、Apacheのトップレベルプロジェクトになった2010年以来、順調に成長を続けていると語り、オンプレミスだけでなくクラウドでの実績も増え、「 300ペタバイト以上のデータを扱えるほどスケーラビリティに長けている」としています。2016年2月には待望のHive 2.0がリリース、高速化メカニズムのLLAP(Live Long and Process)を実装し、「 Hive 1.xに比較して25倍以上のパフォーマンス」( ラディア氏)を実現しています。

Sanjay Radia氏

いくつもの進化を遂げてきたHadoopですが、次のマイルストーンはどこに置いているのか。ラディア氏は「我々の"Hadoop Journey"の次の目標はクラウドへのシフトだ」と、前日のコナリー氏同様、クラウドというトレンドの重要性をあらためて強調しています。クラウド上にHadoopクラスタを構築するメリットとして、ラディア氏は

ITとビジネスにアジリティを与える

ハードウェアコストの上積みが必要ない

クラスタの寿命は一時的でも長期的でもOK

スケールに際限がない

といった点を挙げており、なかでも「作りたいと思ったときに一瞬でHadoopクラスタを構築できるのは非常に大きなメリット」としています。テンポラリでETLやデータ分析環境を用意するのにクラウドは非常に適しており、今後もそのビジネスニーズは拡大する傾向にあります。

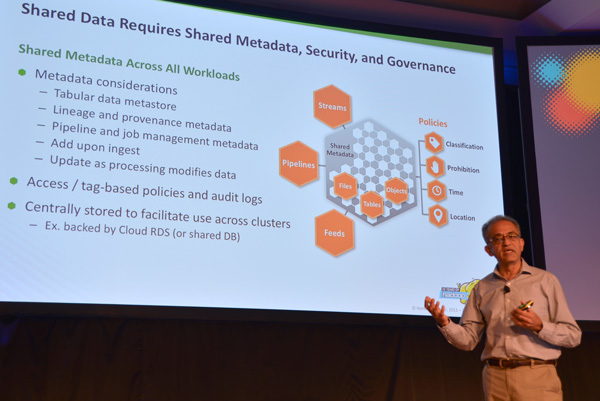

一方でラディア氏は「クラスタをまたいでデータおよびメタデータをストレージ上でいかにシェアしていくかは大きなチャレンジ。データレイクとしてのHadoopをオンプレミスと同じように運用しようとするのは適切ではない。その他、セキュリティやガバナンス、オンデマンドで一時的ななワークロードへの対応、リソースの柔軟な割り当てなど、乗り越えるべき課題は多い」とも指摘します。

データ、メタデータのワークロードをまたいだシェアにおける課題

Hortonworksはここ数年、Microsoftとのパートナーシップを強化しており、クラウド分野でいえば、Microsoft Azureで提供されているHaoopマネージドサービス「HDInsight」はHDPをベースに構築されています。また、AWSやGoogle Cloudでのユースケースも増えつつあり、こうしたパブリッククラウドベンダとの協業で"Hadoop on Cloud"への知見が蓄積されつつあるようです。

キーノートではAWS上に2つのHadoopクラスタを用意し、マーケティングキャンペーンの分析環境を構築、BI(Apache Zeppelin)と連携し、リアルタイムに表示するというデモが披露されました。国内企業でこうしたHadoopの使い方をしているところはまだほとんどありませんが、ごく近い将来にはめずらしくない光景になっているのかもしれません。

日本国内でも進むHadoop利用の大規模化

Hadoop Summitでは、グローバルでのトレンドに加え、各リージョンの代表的なHortonworksの顧客によるHadoopユースケースが紹介されるのですが、今回はリクルートテクノロジーズ、コカ・コーライーストジャパン、三菱ふそうトラック・バス、LIXIL、Yahoo! Japanなどの導入事例がキーノートで紹介されました。

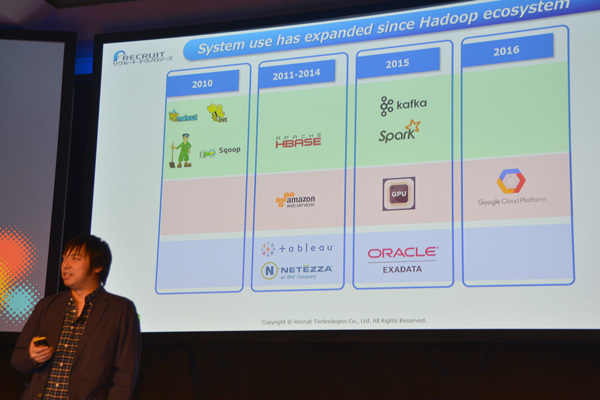

リクルートグループのHadoopクラスタ構築事例は、2011年の公開当初から世界でもトップクラスのユースケースとして有名 ですが、初日のキーノートに登壇したリクルートテクノロジーズ ビッグデータ部 グループマネージャの石川信行氏は「リクルートグループ自身のビジネスが多様化したことにより、数年前とはまったく異なるタイプのデータが毎日大量に生成されている」と語り、データの変容にあわせ、Hadoopクラスタの構成も組織の体制も変化していると明かしています。

リクルートテクノロジーズ 石川信行氏

とくに2014年から2015年にかけての変化は大きく、「 2014年は本番98台/開発24台、データ量は543テラバイトだったのが、2015年には本番165台/開発24台、データ量は1.3ペタバイトに跳ね上がった。エコシステムもHiveやHBaseにとどまらず、SparkやMashoutの活用も増えている」と、Hadoopクラスタの数もデータ量も、活用範囲も劇的に拡大する傾向にあるそうです。なお現在は本番機は174台、開発機は41台、データ量は1.9ペタバイトとのこと。「 採用などにおけるマッチングシステムの最適化やコンテンツのパーソナライゼーション、検索ロジックの最適化などにHadoopをフル活用している」( 石川氏)というリクルートテクノロジーズですが、最近はGoogleクラウドなどパブリッククラウドでのHadoopクラスタ稼働も行っており、来年以降も"世界最先端のHadoop活用企業"であることは変わらないようです。

リクルートテクノロジーズにおけるHadoopエコシステムの移り変わり

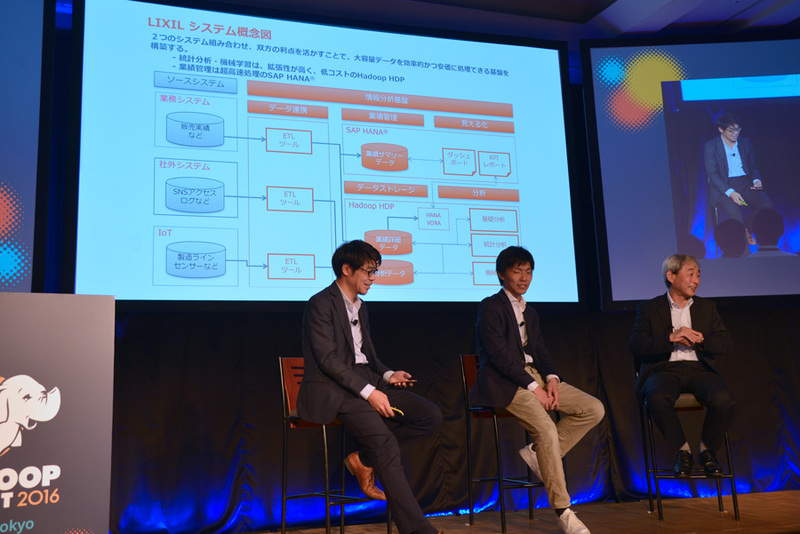

一方、リクルートグループとはまったく異なるステージですが、グループ企業のデータ統合基盤としてHadoop活用にビジネスの可能性を見出そうとしているのがLIXILグループです。LIXILグループはトステムやINAX、サンウエーブといった複数の企業が合併して誕生した企業で、建築材料や住宅設備機器業界においては国内最大手です。しかし統合してからまだ日が浅く、企業文化も商材もまったく異なる企業がひとつになったため、"LIXIL"という名前よりも、トステムやINAXなど旧ブランド名のほうが有名という状況にあり、各社がもつデータも、当然ながらサイロ化した状態でした。今後のグローバル展開も含め、迅速な経営判断を行い、いち企業グループとして新たに出発していくためにはデータ基盤の統合は欠かせないと決断、「 誰が見ても同じ値のKPIが得られるように」( LIXIL Information. Excellence部 ディレクター 菖蒲 真希氏)と、Hadoopによるデータレイク構築に取り掛かり、2018年1月のカットオーバーを目指しています。

2日目のパネルディスカッションで紹介されたLIXILグループのシステム図、パネルのメンバーは右からLIXIL菖蒲氏、Yahoo! Japan Data Platform Division VP 日比野哲也氏、モデレータを務めたホートンワークスジャパン株式会社 マーケティングディレクター 北瀬公彦氏

LIXILではインメモリデータベースのSAP HANAも併用しており、「 基本的にデータはなんでもHadoopに突っ込むようにしているが、定型レポートなどではHANAを利用している」と説明しています。カットオーバー後にはどんなHadoopデータ基盤ができあがっているのか、非常に興味深いです

そろそろ日本でも「米国型カンファレンス」を

2日間のHadoop Summit 2016 Tokyoに参加してもっとも印象に残ったのは、個々のブレイクアウトセッションの質が非常に高く、サンノゼのそれと比べても決して劣っていないという点でした。もちろんデータ分析で世界最先端を行くシリコンバレーの事例ほどの先進性はありませんが、コミュニティメンバーやHortonworksによるHadoopの最新技術情報、ユーザ企業によるビジネスにおける変化、今後の課題などの紹介、AWSやMicrosoftといったパートナー企業によるHadoop関連サービスなど、非常にバランスが取れた、かつ日本のユーザに適したプログラムが組まれており、技術者にとってもビジネスユーザにとっても満足度が高かったのではないでしょうか。他のHadoop Summitと同じ運営会社が担当していることもあり、規模は大きく異なるものの、サンノゼのカンファレンスに似た解放的な雰囲気を強く感じました。音の問題も若干取り沙汰されていましたが、参加者にキーノートやセッションでの写真撮影や録音を許可し、ソーシャルでの共有を好きにさせたことも、これまでの日本のカンファレンスではあまり見られなかった光景です。有料で開催したことも含め、カンファレンスの運営スタイルをグローバル標準に近づけたことは、個人的には非常に高く評価できると思っています。

Hadoopの普及は多くの業界に拡大しており、サンノゼのカンファレンスでは、Google、Facebook、Uber、Airbnbといったデータ分析の最先端企業のほか、金融、エネルギー、ヘルスケアといったクラシックな分野での大規模事例も数多く公開されています。今回の東京開催においてもユニークな国内事例をいくつか知ることができましたが、次の開催時には新旧問わず、より多くの企業による先進的なHadoop事例が聞けることを願っています。

なお、2017年からHadoop Summitは「Data Works Summit」に名称が変更され、4月にドイツ・ミュンヘンで最初の開催が予定されています。データの総合イベントとしてどう進化していくのか、こちらも期待しています。